随着移动办公和娱乐需求的增长,手机投屏到电脑已成为常见需求,但用户往往希望不仅能看到手机画面,还能通过电脑直接操作手机。本文将解析投屏后电脑操作手机的技术原理,并推荐相关软件解决方案。

一、技术原理:远程控制与镜像交互

手机投屏到电脑通常基于Miracast、AirPlay或USB连接等镜像协议,但单纯的投屏仅实现画面传输。若要在电脑上操作手机,需要额外的远程控制技术支持:

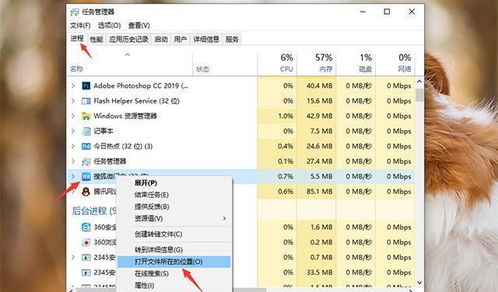

- 底层通过ADB(Android调试桥)或iOS辅助功能接口建立控制通道

- 电脑端模拟触摸事件和按键指令传输至手机

- 手机端接收指令并执行对应操作,同时实时返回屏幕变化

二、实现电脑操作手机的软件方案

- 专业投屏控制软件:

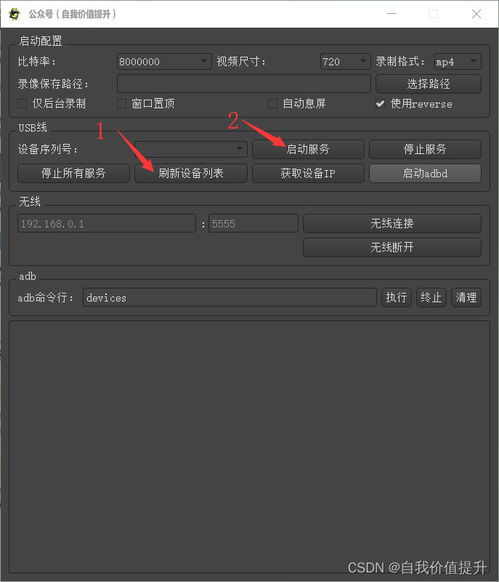

- Scrcpy(开源方案):支持有线/无线连接,延迟低,无需root权限

- ApowerMirror:同时支持Android和iOS,提供键盘映射和手势操作

- Vysor:简洁易用,支持多设备同时管理

- 厂商官方工具:

- 华为/荣耀:多屏协同(需配合特定型号手机和电脑)

- 三星:Samsung Flow(支持跨设备文件传输和通知同步)

- 小米:小米妙享(生态链设备互联)

- 通用远程控制软件:

- TeamViewer QuickSupport:跨平台远程协助

- AirDroid:网页端即可操作手机,支持文件管理

三、计算机软件开发视角

开发此类软件需掌握以下技术栈:

- 移动端:

- Android:熟悉MediaProjection API、InputManager事件注入

- iOS:利用ReplayKit进行屏幕采集,通过Accessibility实现控制

- 桌面端:

- 使用Qt、Electron等框架构建跨平台客户端

- 实现视频解码(H.264/H.265)和输入事件转发

- 网络传输:

- 优化实时视频流传输(WebRTC技术栈)

- 设计低延迟的控制指令协议

四、应用场景与局限性

典型应用场景包括:手游直播、演示教学、远程协助等。但需注意:

- iOS系统因权限限制,操作功能相对有限

- 部分银行类APP会检测投屏状态并阻断操作

- 高帧率游戏可能因编码延迟影响操作体验

随着5G和低延迟编码技术的进步,电脑操作手机的体验将不断提升。开发者可关注新兴的云手机技术,通过虚拟化方案实现更彻底的跨设备融合操作。